五种降低网络安全应用中大型语言模型风险的策略

加强人工智能在网络安全中的应用治理

关键要点

当前许多组织在网络安全中应用人工智能AI时,需要深化尽职调查和监督。根据德勤的报告,多达66的组织遭遇了勒索软件攻击,物联网恶意软件攻击增加了400。大型语言模型LLMs具备新的挑战与风险,需采用不同的方法来降低其潜在威胁。在网络安全领域,即使许多首席信息安全官CISOs和首席信息官CIOs已经制定了人工智能政策,但越来越明显的是,使用AI时需加强尽职调查、监督与治理。根据德勤的年度网络威胁报告,66的组织遭遇了勒索软件攻击。此外,物联网恶意软件攻击增加了400。在2023年,91的组织需要修复影响其代码或系统的软件供应链攻击。

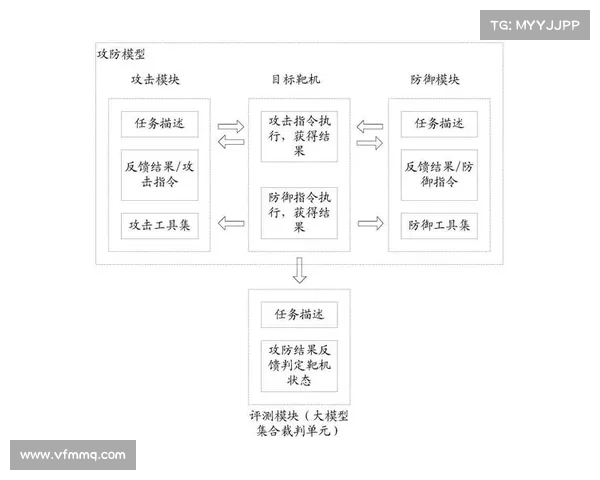

过去有效的网络安全实践未能跟上大型语言模型LLMs所带来的新能力和威胁。这些LLMs通过大量数据训练,既能增强安全操作团队的能力,也可能使其面临更复杂的威胁。由于LLMs与其他安全工具的不同,必须采用全新的方法来降低其风险。这些方法既包括新兴的安全技术,也有调整过的传统策略。以下是几种可行的措施:

措施描述对抗训练在微调或测试过程中,安全专家应将LLMs暴露在旨在测试其边界的输入中,以诱导LLM打破规则或进行恶意行为。内置可解释性在LLMs中,“可解释性”指的是能够解释特定输出的原因,安全LMM供应商需要在其工具中增加可解释性层。持续监控监测安全控制系统不是新事物,LLMs的监控必须能够检测到真实使用中异常或意外的输出。人机协作由于LLMs的新颖和潜在风险,组织应将LLM的建议与人类专家相结合用于关键决策。沙箱测试与渐进部署在实际部署前,必须在隔离环境中彻底测试LLMs,以确保其在接近实际网络安全流程的条件下运行。LLMs带来了更高的意外风险,因此我们应密切监控其集成、使用和维护协议。在CISO确认LLM足够安全和有效后,可以逐步进行部署。为取得最佳效果,初期应将LLM应用于不太关键和复杂的任务,并逐步引入那些需要人类良好判断的认知挑战性流程。

Aqsa Taylor 产品管理总监 Gutsy

快喵加速器苹果版